文章目录[隐藏]

- 视觉招聘小黑板

- 行业资讯

- 阿普奇通过多重管理体系认证,重塑企业管理新标杆--机器视觉网 2024-01-19 11:02:04

- 西克新品上市multiScan136 3D 区域避障模块--机器视觉网 2024-01-19 10:38:30

- 跨维智能获2023年深圳市“专精特新”企业认定--机器视觉网 2024-01-19 10:35:18

- 研华科技与科强信息达成战略合作,共探塑料成型行业智造新发展--机器视觉网 2024-01-19 10:27:30

- 思特威获得 ISO 26262 ASIL B功能安全产品认证证书--机器视觉网 2024-01-19 10:16:41

- 基于机器视觉的机械加工件的表面缺陷检测方案--机器视觉网 2024-01-19 11:38:45

- 纳米光学与机器学习相结合,赋能片上近红外光谱传感--机器视觉网 2024-01-19 11:31:16

- 手眼标定在工业机器人视觉定位引导系统中的应用--机器视觉网 2024-01-19 11:14:09

- 宜科LVM2240 3D激光轮廓传感器助力车身铆钉检测精准高效--机器视觉网 2024-01-19 10:03:42

- 高芯科技携多款消费电子领域红外产品亮相CES 2024―新闻频道- 视觉系统设计 2024/1/18 23:58:17

- 阿丘科技荣登机器之心、胡润、36氪多个权威榜单―新闻频道- 视觉系统设计 2024/1/18 23:57:30

- 海康机器人携手菜鸟(香港)科技赋能年货节―技术与应用频道- 视觉系统设计 2024/1/19 0:00:53

- 全流程机器视觉工程开发(一)环境准备,paddledetection和labelme 2024-01-18 17:13

- SceneVerse:扩展3D视觉语言学习,用于基于场景的理解 2024-01-19 09:56

- 事件相机(EVS or DVS)是什么 2024-01-19 15:27

- CV计算机视觉每日开源代码Paper with code速览-2024.1.18 2024-01-19 01:03

- 顶会ICLR2024:当语义分割遇见频率混叠 | When Sementic Segmentation Meets Frequency Aliasing | 北京理工大学 2024-01-19 16:08

- 当语义分割遇见频率混叠 | 顶会ICLR2024 When Sementic Segmentation Meets Frequency Aliasing | 北京理工大学 2024-01-19 00:45

- 又一个Corner Case : 反光地面异常物体检测 2024-01-19 00:39

- 湾大余梓彤与深大沈琳琳解为成拟招收24年fall联培人工智能专业硕士(计算机视觉方向) 2024-01-19 15:51

- ICLR 2024 Oral | 基于文本的分解来解释 CLIP 的图像表示 2024-01-19 11:04

- 多视图几何三维重建实战系列之R-MVSNet 2024-01-18 15:52

- 3D高斯喷溅简单上手 2024-01-18 17:04

- Deformable ConvNets v4来啦,比Flash Attention还快还好 2024-01-19 11:51

- Launch: Active Learning with Roboflow: 2024-01-19T12:08:13.000Z

视觉招聘小黑板

欲了解详情,请在公众号后台回复:240119

行业资讯

阿普奇通过多重管理体系认证,重塑企业管理新标杆--机器视觉网 2024-01-19 11:02:04

2024-01-19 11:02:04 来源: 中国机器视觉网

在当今高度竞争的市场环境中,企业成功的关键不仅在于产品和服务的品质,更在于各种管理体系的先进性和有效性。阿普奇深知这一点,通过不断努力,于2023年12月底再次通过ISO9001质量管理体系认证审核。这标志着阿普奇已经建立了较为完善的质量管理体系,为其持续发展奠定了坚实基础。

阿普奇的管理体系涵盖了多个重要领域,确保了企业运营的各个方面都达到了国际标准。这一体系不仅关注产品的质量,更涉及到企业的环境管理、职业健康安全、知识产权保护、社会责任履行、信息安全以及安全生产等方面。

阿普奇始终将质量管理作为公司运营的核心任务,12月阿普奇又一次通过ISO9001认证,建立了一套完整的质量管理体系,确保产品从研发到生产都符合严格的标准。这一体系的有效运

......长按二维码访问原文

西克新品上市multiScan136 3D 区域避障模块--机器视觉网 2024-01-19 10:38:30

2024-01-19 10:38:30 来源: 中国机器视觉网

迈向工业4.0智能化的道路上,3D激光雷达扮演着数字化世界不可或缺的角色,不仅充当了自动驾驶车辆和机器人的“眼睛”,而且通过获取的3D点云成为认知世界的“记忆”。

在各种各样户外恶劣条件下如雨、雪、雾、粉、低温等,稳定可信赖的3D LiDAR将事半功倍,西克推出专为工业车辆及移动机器人市场开发的高精度室内外工业级16线激光雷达multiScan136 3D 区域避障功能,为您的各类挑战性应用保驾护航!

产品特点

产品功能

3D LiDAR 传感器 multiScan136是一款全能型室内外工业级产品。它不仅可以同时对环境进行建图和定位,还可以同步进行 3D环境感知。

工业级的设计,无论硬件还是软件,都保证了其流程的稳固性,其性能使客户长

......长按二维码访问原文

跨维智能获2023年深圳市“专精特新”企业认定--机器视觉网 2024-01-19 10:35:18

2024-01-19 10:35:18 来源: 中国机器视觉网

近日,深圳市中小企业服务局发布了关于2023年深圳市专精特新中小企业名单的公示。经过层层严格遴选,跨维(深圳)智能科技有限公司(简称“跨维智能”)凭借科技研发实力和市场竞争优势,荣获“深圳市专精特新”企业称号。

根据《深圳市工业和信息化局专精特新中小企业遴选办法》,“专精特新”企业是指主营业务和发展重点符合国家产业政策及相关要求,具备“专业化,精细化,特色化,新颖化”特征,且拥有创新能力强、发展质量高、经济效益好的企业,是深圳市政府推出的重要企业支持计划之一,旨在通过识别、表彰和扶持具有核心技术、市场竞争力和发展潜力的中小企业。此次荣获殊荣,是对跨维智能在技术研发、产品创新、市场拓展等方面取得的突出成绩的肯定与认可。

跨维智能是一家以 Sim

......长按二维码访问原文

研华科技与科强信息达成战略合作,共探塑料成型行业智造新发展--机器视觉网 2024-01-19 10:27:30

2024-01-19 10:27:30 来源: 中国机器视觉网

研华科技与科强信息签署战略合作协议,未来将共同推动塑料成型产业的数字化转型。双方将整合技术创新能力及实践经验,促进新技术与业务场景的融合,共同打造更高效的行业模式。

2024年1月15日,研华科技与杭州科强信息技术有限公司(以下简称“科强信息”)签署战略合作协议,研华科技工业物联网事业群副总经理李景恩及科强信息总经理许文杰出席活动,并就塑料成型产业市场发展、双方应用实践能力以及行业共创合作等方面展开深入探讨,双方将整合各自技术创新能力、产业实践经验以及品牌影响力,推动成型行业在塑料成型及金属成型的设备联网、低代码平台、智能制造、数字孪生、绿色制造等新技术与业务场景融合,共同打造“1+1〉2”的行业模式。

塑料成型行业指的是以塑料为原料,通

......长按二维码访问原文

思特威获得 ISO 26262 ASIL B功能安全产品认证证书--机器视觉网 2024-01-19 10:16:41

2024-01-19 10:16:41 来源: 中国机器视觉网

1月18日,独立第三方国际权威汽车检验、检测和认证机构DEKRA德凯正式授予思特威(上海)电子科技股份有限公司Automotive Sensor (AT) Series系列车规级CMOS图像传感器(CIS)产品SC225AT/SC320AT ISO 26262 ASIL B功能安全产品认证证书。

思特威联合创始人兼首席技术官莫要武博士、思特威汽车芯片部资深销售总监邹亚飞先生、DEKRA德凯亚太区高级副总裁、中国大陆及香港董事总经理Dr. Kilian Aviles林一墨博士、DEKRA德凯中国功能安全总经理李明勋先生以及双方相关负责人出席了此次颁证仪式。

思特威荣获DEKRA德凯ISO 26262 ASIL B功能安全产品认证证书

获得AS

......长按二维码访问原文

基于机器视觉的机械加工件的表面缺陷检测方案--机器视觉网 2024-01-19 11:38:45

2024-01-19 11:38:45 来源: 中国机器视觉网

在当今高度竞争的工业生产过程中, 机械零件表面检测技术作为一种产品质量控制的重要手段, 被广泛地用于工业过程的质量控制。

而在机械加工自动化行业, 由于加工过程的刀具行程的变化、材料的本身特性、振动、刀具的损伤以及抛光处理不恰当等, 都会在机械加工零件表面形成凹痕、擦伤、外观变形、方向不正、不理想的反光特性等等缺陷。

解决机械加工零件表面纹理缺陷的重要性

机械加工零件过程中,对表面纹理缺陷进行检测非常关键,直接决定了零件的加工质量,对于零件的使用性能也有非常重要的影响。一个好的机器内部都是由各种零件构造组成的,如果机器不过关首先从零件上找问题,会影响机器的正常运转,还有可能造成不可计算的后果。

在机械零件加工的过程中, 会受到材料影响,

......长按二维码访问原文

纳米光学与机器学习相结合,赋能片上近红外光谱传感--机器视觉网 2024-01-19 11:31:16

2024-01-19 11:31:16 来源: 中国机器视觉网

光谱传感检测技术是科学研究和工业生产中广泛应用的一种光学分析技术,凭借其对物质光谱指纹的特异性辨识能力,在生物医药、遥感测绘、环境监测、智慧农业、工业自动化等领域起到了不可替代的作用。随着现场快检和轻载荷平台应用需求的急剧增加,常规的桌面型光谱仪因为体积大、操作复杂、价格昂贵等问题难以达到技术要求,迫切需要便携式、低成本的光谱传感检测平台;而大数据、物联网等信息技术的快速发展,也有望通过与便携式光谱检测技术融合开启全新的应用。

近年来各种光谱系统小型化的技术层出不穷,甚至有芯片级的光谱检测平台的报道。这些技术通过各种先进的光色散结构与数十或数百单元的探测器阵列集成获得片上集成的光谱采样与解调,展现了极具特色的小型化光谱检测平台。目前大多数研究报

......长按二维码访问原文

手眼标定在工业机器人视觉定位引导系统中的应用--机器视觉网 2024-01-19 11:14:09

2024-01-19 11:14:09 来源: 中国机器视觉网

随着工业的发展,在生产中对自动化的要求越来越高,视觉技术已被广泛引入工业机器人行业,具备视觉的工业机器人能更快、更准、更灵活地完成定位抓取、对位组装、码垛拆垛等,视觉引导是工业机器人走向智能化的重要方式。传统的工业机器人只能按照编写好的程序做单调重复的工作,无法根据作业环境自适应调整运动轨迹,视觉引导系统赋予了机器人感知外部世界的能力。

视觉引导技术介绍

基于图像分析的视觉技术在机器人引导相关应用中的主要作用是精确获取对象物(待抓取物体)和目标物(待组装物体)的坐标位置,并将图像坐标转换为机器人能识别的机器人坐标,指导机器人进行纠偏和组装。因此,手眼标定和定位引导是机器视觉在(工业机械臂)机器人引导中应用的核心。

手眼标定目的及分类

......长按二维码访问原文

宜科LVM2240 3D激光轮廓传感器助力车身铆钉检测精准高效--机器视觉网 2024-01-19 10:03:42

2024-01-19 10:03:42 来源: 中国机器视觉网

汽车制造作为精密制造的天花板,车身上的一个铆钉都决定着整部车的质量,因此对于汽车天窗结构件铆钉的检测至关重要。

传统的检测方法是凭借人工经验去测量和判断,但该方法容易受检测人员主观意愿、情绪、视觉疲劳等人为因素的影响,使检测结果出现偏差疏漏。因此用机器视觉替代人眼检测,就成为了企业必然的选择。

基于机器视觉的汽车天窗结构件铆钉检测,利用激光三角测量技术,通过对汽车天窗结构件进行扫描,检测工件上铆钉数目及状态是否符合要求,检测方案具有非常高的精度。

宜科LVM2240 3D激光轮廓传感器

方案需求

针对汽车天窗结构件进行检测,尺寸约1200 mm × 1200 mm。具体要求如下:检测工件上的铆钉数目;检测铆钉是否存在半铆状态;精度要求:

......长按二维码访问原文

高芯科技携多款消费电子领域红外产品亮相CES 2024―新闻频道- 视觉系统设计 2024/1/18 23:58:17

1月9日,全球规模最大、水平最高、影响最广的消费类电子技术年展CES 2024在美国拉斯维加斯开幕!本届CES汇聚4000+顶尖电子及IT核心厂商,共见消费电子行业新技术及新趋势,同树未来全球消费电子产业发展风向标。

高芯科技作为红外热成像核心器件的头部供应厂商,联袂兄弟厂商一道,携多款消费电子领域的红外产品亮相大会,为现场观众及终端用户带来红外全产业链的“热力“呈现。

CES 2024的主题为“AII Together,AII On”,旨在强调全球消费电子产品的融合与协同。红外热成像技术作为人类视觉在热量感知领域的延伸,已经越来越多引起终端整机用户的注意,更多类型的红外核心器件加速融合到各类创新型消费电子产品之中。

超微型红外模组

超微型结构设计,辅以新一代图像算法,加上更简易的二次开

......长按二维码访问原文

阿丘科技荣登机器之心、胡润、36氪多个权威榜单―新闻频道- 视觉系统设计 2024/1/18 23:57:30

近日,阿丘科技再获 4 项大奖,凭借技术研发硬实力与强劲的发展潜力,获得多家专业媒体与权威机构的肯定。

机器之心

人工智能领军企业 TOP 20

由人工智能领域知名媒体机器之心评选的“「AI中国」机器之心2023年度榜单”正式揭晓,阿丘科技入选“人工智能领军企业TOP20”。此次成功入选,是行业权威媒体和评委专家对阿丘科技综合实力的肯定!

机器之心指出,「人工智能领军企业」上榜企业在技术研发、落地应用、商业模式等方面构建了完整的运营能力和竞争优势,促进产业发展,引领技术创新,且在细分领域形成了竞争壁垒并拥有主导地位。

阿丘科技持续专注为客户提供优质方案,赢得客户信任。至今,阿丘科技已服务于50+行业标杆客户,并在多个高新技术领域实现了行业级检测难题的突破。

胡润研究院

2023胡润全球猎豹企业榜

......长按二维码访问原文

海康机器人携手菜鸟(香港)科技赋能年货节―技术与应用频道- 视觉系统设计 2024/1/19 0:00:53

香港作为全世界最繁忙的城市之一,对效率有着极致的追求。年关将至,年货需求不断增加,随着订单量激增,普通人工管理的仓库容易出现爆仓和业务超负荷的情况。在寸土寸金的香港打造高效运转的电商仓库,以智能的自动化设备及数据管理平台为核心,实现效率加速,已成为行业共识。

菜鸟是全球TOP级跨境电商物流公司,香港作为全球物流中心,是菜鸟国际毋庸置疑的重点市场。香港土地面积小、租赁成本高,同时用人成本也较大。引入海康机器人智慧物流解决方案,有效提升仓库空间利用率,缩短物流时效,同时加快订单在大促期间的流转效率。

看海康机器人如何与菜鸟(香港)携手,实现效率与存储双赢!

解决方案 • 价值共生

该项目采用料箱机器人20台,梳齿工作站4台,搭配海康机器人自主研发的机器人调度系统RCS和智能仓储管理系统iWMS,在库区内实现

......长按二维码访问原文

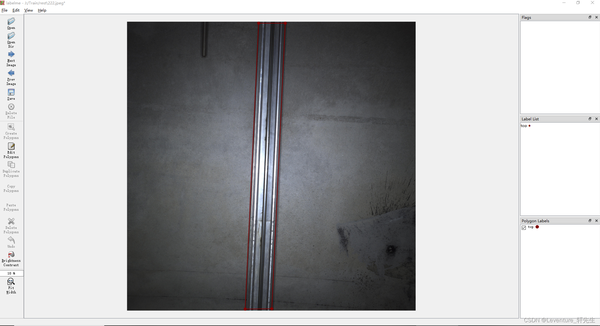

全流程机器视觉工程开发(一)环境准备,paddledetection和labelme 2024-01-18 17:13

前言

我现在在准备做一个全流程的机器视觉的工程,之前做了很多理论相关的工作。大概理解了机器视觉的原理,然后大概了解了一下,我发现现在的库其实已经很发展了,完全不需要用到非常多的理论,只需要知道开发过程就可以了,甚至paddlex已经直接有了傻瓜式模型训练的软件,所以我现在准备来做一个全流程机器视觉工程开发,不涉及过多理论。

准备

现在准备一下机器视觉工程的前情提要。

我准备使用paddledetection来做机器视觉。什么是paddleDetection?你可以理解为paddlepaddle对于目前主流的机器学习模型做了一些整合,只需要使用paddleDetection库就可以做一个很方便的训练、预测等工作。

准备好paddledetection之后,也就是我们的模型工具之后,还需要对现有图片做一些

......长按二维码访问原文

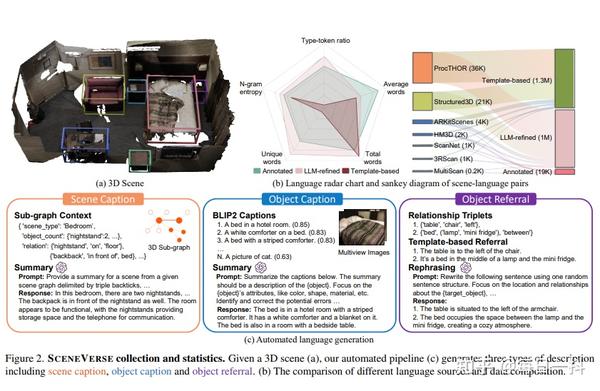

SceneVerse:扩展3D视觉语言学习,用于基于场景的理解 2024-01-19 09:56

SceneVerse: Scaling 3D Vision-Language Learning for Grounded Scene Understanding

标题:SceneVerse:扩展3D视觉语言学习,用于基于场景的理解

地址:https://arxiv.org/pdf/2401.09340.pdf

摘要:3D视觉语言对齐,侧重于将语言与3D物理环境相匹配,是发展具有实体能力的代理的基石。与2D领域的最新进展相比,将语言植根于3D场景面临着几个重大挑战:

(i) 由于多样的对象配置、它们丰富的属性和错综复杂的关系,3D场景的固有复杂性;(ii) 缺乏支持植根学习的成对3D视觉语言数据;以及(iii) 缺乏从植根3D数据中提炼知识的统一学习框架。在这项工作中,我们旨在通过系统地扩展室内环境中的3

......长按二维码访问原文

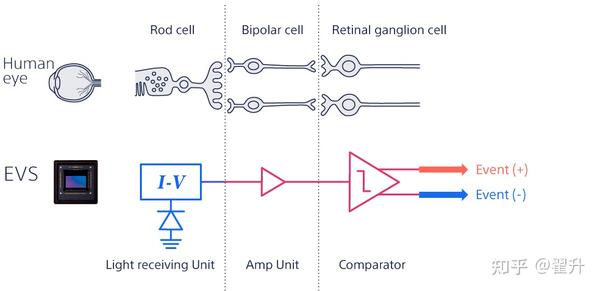

事件相机(EVS or DVS)是什么 2024-01-19 15:27

基于事件的视觉传感器(EVS)是一种新型的图像传感技术,这种传感器依然拥有一个像素阵列。每个像素内都有专用电路对像素的亮度变化进行实时监测,如果亮度变化超过预设阈值即会触发事件输出。输出数据包括触发事件的像素坐标(x,y)以及事件类型(ON-变亮,OFF-变暗 两种事件类型),如果有在传感器内集成时间戳电路可以对事件发生时间进行标记,并将事件触发事件连同事件的坐标和事件类型一起输出。能够实现低延迟的高速数据输出。相对于传统的图像传感器,EVS更注重捕捉场景中的运动变化。EVS的像素设计一般采用log像素设计,即输出表征亮度的电压和亮度成log关系,因此可以实现更大的动态范围。

这种传感器的主要特点包括高速数据输出和低延迟,使其在需要快速反应的应用中具有优势。由于EVS能够仅在感知到亮度变化时触发,而不需要连续

......长按二维码访问原文

CV计算机视觉每日开源代码Paper with code速览-2024.1.18 2024-01-19 01:03

精华置顶

墙裂推荐!小白如何1个月系统学习CV核心知识:链接

点击@CV计算机视觉,关注更多CV干货

论文已打包,点击进入—>下载界面

点击加入—>CV计算机视觉交流群

1.【基础网络架构:CNN】LKCA: Large Kernel Convolutional Attention

2.【目标检测】DualTeacher: Bridging Coexistence of Unlabelled Classes for Semi-supervised Incremental Object Detection

3.【超分辨率重建】Transforming Image Super-Resolution: A ConvFormer-based Efficient Approach

4.【行人重识别】CLI

......长按二维码访问原文

顶会ICLR2024:当语义分割遇见频率混叠 | When Sementic Segmentation Meets Frequency Aliasing | 北京理工大学 2024-01-19 16:08

国际机器学习顶会 ICLR2024

主题:当语义分割遇见频率混叠 When Sementic Segmentation Meets Frequency Aliasing

作者:Linwei Chen, Lin Gu, Ying Fu

单位:北京理工大学,东京大学

原文地址:https://openreview.net/pdf?id=SYBdkHcXXK

Code:https://github.com/Linwei-Chen/Seg-Aliasing

摘要:

虽然近来语义分割取得了很大进展,但是很少有人探索过”什么样的像素或者哪里的像素难分割“这样的问题。现有的研究只是将图像分割成easy pixel和hard pixel,并且经验主义地观察到后者与物体的边界相关。在本文中,我们对hard pi

......长按二维码访问原文

当语义分割遇见频率混叠 | 顶会ICLR2024 When Sementic Segmentation Meets Frequency Aliasing | 北京理工大学 2024-01-19 00:45

国际机器学习顶会 ICLR2024

主题:当语义分割遇见频率混叠 When Sementic Segmentation Meets Frequency Aliasing

作者:Linwei Chen, Lin Gu, Ying Fu

单位:北京理工大学,东京大学

原文地址:https://openreview.net/pdf?id=SYBdkHcXXK

Code:https://github.com/Linwei-Chen/Seg-Aliasing

摘要:

虽然近来语义分割取得了很大进展,但是很少有人探索过”什么样的像素或者哪里的像素难分割“这样的问题。现有的研究只是将图像分割成easy pixel和hard pixel,并且经验主义地观察到后者与物体的边界相关。在本文中,我们对hard pi

......长按二维码访问原文

又一个Corner Case : 反光地面异常物体检测 2024-01-19 00:39

1 前言:被忽视的反光地面

随着自动驾驶技术的不断发展,各类特殊情况(Corner Case)不断浮出水面,包括大型、倾斜、小型、异常等各种障碍物。然而,鲜有研究将注意力聚焦于障碍物所处的环境,而非仅仅关注障碍物本身。对于室内服务型机器人而言,光滑且具有反光效果的地面场景相当常见,例如教学楼中的瓷砖地板或雨后路面上的积水。

我们发现,当机器人在这类环境中进行导航时,往往会误将地面的反光纹理识别为障碍物。为了深入探讨这一现象的原因并找到解决方案,我们展开了一项关于反光地面异常物体检测的研究,并制定了首个相关Benchmark。

2 为什么反光地面上的障碍物很难被检测出来?

我们将地面反光区域的真实世界的反射称为非真实物体(Unreal Object,UO),正如上图所展示的场景中教室窗户的反光所示。一

......长按二维码访问原文

湾大余梓彤与深大沈琳琳解为成拟招收24年fall联培人工智能专业硕士(计算机视觉方向) 2024-01-19 15:51

参考链接为:https://csse.szu.edu.cn/pages/recruitment/details?id=3819

为进一步深化研究生教育综合改革,服务国家、省战略需求,推动新设本科高校快速提升人才培养水平,深圳大学与大湾区大学(筹)(以下简称“湾大”)开展联合培养硕士研究生项目。

湾大是在国家粤港澳大湾区建设背景下创建的一所以理工科为主的新型高水平研究型大学。湾大计算机专业是湾大首批建设的学科之一,重点建设前沿计算技术、人工智能及其应用等方向。

湾大联培导师介绍:

余梓彤,大湾区大学(筹)信息科学技术学院助理教授。博士毕业于芬兰奥卢大学,师从Guoying Zhao教授(欧洲科学院院士,IEEE Fellow),博士期间曾在牛津大学Philip Torr教授(英国皇家学会会士) 组开展访问

......长按二维码访问原文

ICLR 2024 Oral | 基于文本的分解来解释 CLIP 的图像表示 2024-01-19 11:04

本文通过将CLIP的图像表示分解为可解释的文本元素来解释它,这些元素被归因于各个注意力头部和图像位置,并利用这些发现来减少虚假特征以改进零样本分割,代码已开源!

点击关注 @CVer官方知乎账号,可以第一时间看到最优质、最前沿的CV、AI、遥感工作~

Interpreting CLIP's Image Representation via Text-Based Decomposition

单位:UC 伯克利

主页:https://yossigandelsman.github.io/clip_decomposition/

代码:https://github.com/yossigandelsman/clip_prs

论文:https://arxiv.org/abs/2310.05916

CVPR 20

......长按二维码访问原文

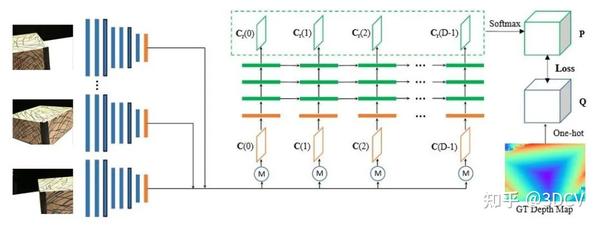

多视图几何三维重建实战系列之R-MVSNet 2024-01-18 15:52

R-MVSNet同样是香港科技大学姚遥等人在CVPR2019上提出的一种深度学习框架,它在MVSNet的基础上,解决了正则化过程中GPU消耗大、无法估计较大场景和高分辨率照片的问题。下面我们一起阅读一下这项工作~

推荐阅读

......长按二维码访问原文

3D高斯喷溅简单上手 2024-01-18 17:04

(因为是从飞书文档迁移过来的,格式比较丑)

基本介绍

官方主页和 Github 仓库

基本思路:将空间像素看成一个个椭圆,用 GMM 对图像进行拟合

https://repo-sam.inria.fr/fungraph/3d-gaussian-splatting/

https://github.com/graphdeco-inria/gaussian-splatting

推荐的 Youtube 教程和仓库

建议跟着教程一步步走(视频全长40分钟,配合本文档阅读)

https://www.youtube.com/watch?v=UXtuigy_wYc

https://github.com/jonstephens85/gaussian-splatting-Windows?tab=readme-

......长按二维码访问原文

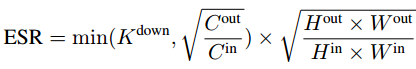

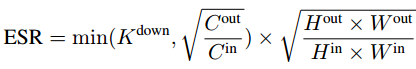

Deformable ConvNets v4来啦,比Flash Attention还快还好 2024-01-19 11:51

Deformable ConvNets v4来啦,速度大幅加快,比flash attention还快。没有损失性能,性能还有提升。Deformable ConvNets是我们2017在视觉领域提出的动态注意力机制,比Transformer论文还早半年。之前同行反馈一直都是性能很好,速度偏慢,是不是动态位置采样就是这么慢?过了这么多年,我们才回过头仔细优化了算子,发现,其实是同学们之前实现的太低效了。。。

GitHub:https://github.com/OpenGVLab/DCNv4

......长按二维码访问原文

Launch: Active Learning with Roboflow: 2024-01-19T12:08:13.000Z

When training computer vision models, it’s best to train on data representative of your use case.

For example, consider a scenario where you want to label freight containers for use in a yard management solution. Gathering images of freight containers from your own yards will allow you to train a more effective model. This is because your input data will be

......长按二维码访问原文